【투데이신문 조유빈 기자】 최근 딥페이크 기술을 이용해 타인 얼굴 사진을 음란물 영상에 합성한 뒤 이를 유포하겠다고 협박하거나 금전을 취하는 범죄가 기승을 부리고 있다.

28일 국회부의장인 김상희 의원이 방송통신심의위원회에서 제출받은 자료에 따르면 성적 허위영상 차단‧삭제 건수는 지난해 6월부터 12월까지 548건 수준이었으나 올해들어 9월까지 1408건으로 2.5배 이상 증가했다.

딥페이크란 심층학습(Deep Learning)과 가짜(Fake)의 합성어로 인공지능(AI)을 이용해 허위 영상을 만들어내는 기술이다.

딥페이크 성적 허위영상물의 제작 및 반포 행위를 금지하기 위한 ‘성폭력범죄의 처벌 등에 관한 특례법’이 지난해 3월 국회 본회의를 통과, 같은해 6월 25일부터 시행됐다. 하지만 딥페이크의 범죄수법은 오히려 진화하는 모습이다.

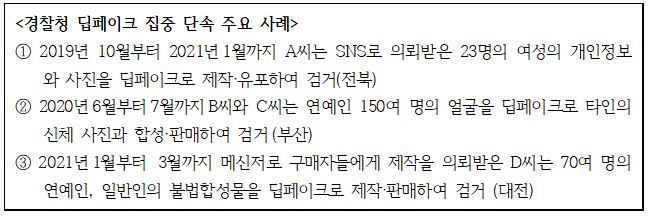

경찰청이 김 부의장에게 제출한 자료를 살펴보면 범죄자들은 SNS와 채팅 메신저 등으로 일반인 또는 연예인들의 사진과 개인정보를 받아 성적 허위 영상물을 제작·판매 및 유포한 것으로 나타났다.

해외에서도 딥페이크를 악용해 회사 고위 임원의 목소리나 친구의 얼굴을 모방해 영상통화를 걸어 금전을 요구하는 범죄가 발생하고 있다.

딥페이크 불법 영상물을 확실하게 단속하지 못할 경우 다크웹 등으로 퍼져나가 ‘제2의 N번방 사건’이 될 가능성이 높다는 우려의 목소리가 나오고 있다.

이에 따라 AI를 포함한 지능정보기술을 악용한 범죄피해를 막기 위해서는 기술에 대한 규제가 필요하다는 지적이 제기됐다.

현행 ‘지능정보화 기본법’ 제31조와 제60조에 따르면 지능정보기술이 사람의 생명과 신체의 안전을 저해하면 이를 제한하고 필요할 경우 국가가 그 기술을 비상 정지할 수 있다.

현재까지 AI 등 지능정보 기술이 사람의 생명 또는 신체에 긴급한 위해를 가하는 등 규정을 위배한 사례는 없지만, 악용 범죄는 계속 이어지고 있어 현실적인 개선책이 필요한 상황이다.

이와 관련해 김상희 의원실은 “현행법에는 AI를 악용하여 심각한 정신적, 금전적 피해를 주는 것에 대한 규정이 없다”라며 “AI를 악용한 범죄를 예방하고 큰 피해를 막기 위해 심각하게 지능정보 기술을 악용한 경우는 기술의 사용을 제한하거나 중지할 수 있게 해야 한다”고 말했다.

이어 “미래산업 사회에 진입을 위해 AI 발전은 꼭 필요하지만 인간에게 심각한 피해를 끼친다면 정부가 직접 나서야 한다”며 “AI 범죄를 신종 범죄로 규정하고 AI의 불법행위와 악용을 막을 방안을 마련해 더 이상 AI 범죄로 고통받는 국민이 없도록 노력하겠다”고 강조했다.

아울러 “AI 기술의 발전과 딥페이크 사용자의 급증으로 이를 악용한 범죄가 많아지고 있는 가운데, 그에 대한 규제가 없다”라며 “정부가 나서서 협의체 등을 구성해 AI의 불법행위나 악용되고 있는 기술을 긴급적으로 중지시키거나 심한 경우에는 폐기할 수 있는 방안도 고려해봐야 된다”고 덧붙였다.